Intelligenza artificiale e robotica

Su segnalazione di Roberto Alvisi diffondiamo cinque testi sulla robotica abbinata alla intelligenza artificiale

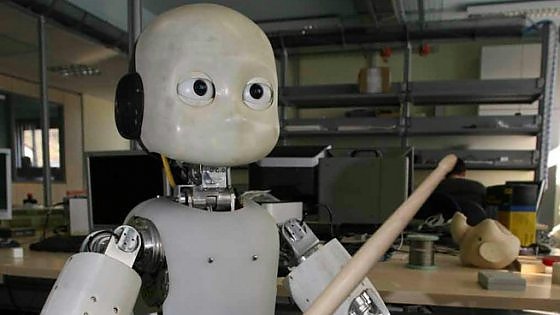

1. Claudio Cucciatti: Intelligenza artificiale, in 5 anni i robot sostituiranno il 6% degli americani sul posto di lavoro

da www.repubblica.it del 16 settembre 2016

Il rapporto. “Nei prossimi cinque anni – si legge nelle pagine redatte da Forrester – gli agenti intelligenti, da semplici, diventeranno robot sofisticati. Le aziende potranno puntare su questi strumenti per ridurre il costo del lavoro”. L’impatto negli Stati Uniti, tra i Paesi tecnologicamente più avanzati, si preannuncia devastante: sei lavoratori americani su cento saranno sostituiti dalle macchine.

Assistenti vocali. Interroghiamo con leggerezza Siri, l’assistente virtuale degli iPhone, sul meteo del prossimo fine settimana o sul percorso per raggiungere l’hotel più vicino. Lo si fa come se fosse un gioco, alterando la voce e facendo facce strane, spesso stupide, convinti che quella vocina metallica e accomodante sia rinchiusa in un pozzo troppo profondo per rispondere alle nostre provocazioni. Su internet o sulle riviste di tecnologia leggiamo che Google e Uber costruiscono automobili senza pilota, per un futuro che immaginiamo non proprio prossimo. Manca la consapevolezza, a tal punto dallo stentare nel crederci, che tra cinque anni questi strumenti possano evolversi e sostituire l’uomo in attività molto complesse, a partire dal lavoro. Nel rapporto Forrester si citano i rappresentanti dei servizi clienti, gli addetti dei call center e gli autisti di taxi e camion come le figure professionali a rischio estinzione. Se in un lustro le prospettive sono queste, molti altri impieghi saranno affidati completamente all’intelligenza artificiale entro la metà del secolo.

Oltre al fatto che donne e uomini saranno costretti a reinventare se stessi (o una nuova professone) per trovare un impiego, un aumento (ulteriore) della disoccupazione potrebbe portare a disordini sociali. Non si tratta di una visione catastrofica: i padri delle nuove tecnologie hanno più volte messo in guardia sulla pericolosità di un utilizzo scorretto o sproporzionato delle proprie creature. “Prima le macchine faranno un sacco di lavoro per noi – parola di Bill Gates – e non saranno super intelligenti. Sarà positivo, se saremo capaci di maneggiarle bene . Un paio di decenni più tardi questa intelligenza diventerà un problema”. Toni più apocalittici sono stati usati dal fondatore di Tesla e SpaceX, Elon Musk: “Affidare l’intelligenza ai computer è come invocare il demonio”.

Tra i problemi del futuro, dunque, dovremmo aggiungere anche il ‘controllo della tecnologia’, una minaccia che al momento pare trascurata: “I politici preferiscono parlare di lauree e di formazione tecnica,

riferendosi a strumenti vecchi di almeno cinque o dieci anni. Non ci rendiamo conto – ha detto Andy Stern, ex presidente della Service Employees International Union – di quanto velocemente il futuro sta arrivando”. Cinque anni passano in un lampo, meglio iniziare a riflettere.

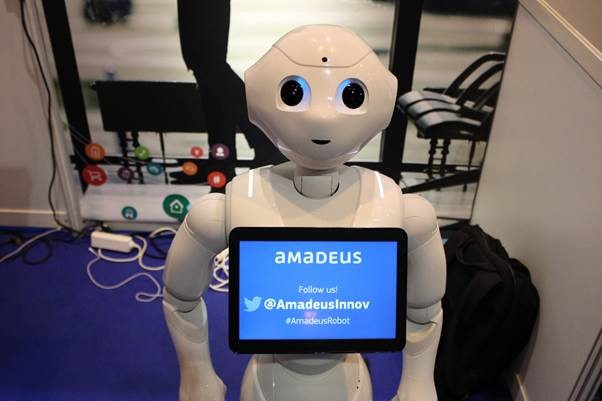

2. Giorgio Bellocci: Anche in Italia la robot therapy con Pepper

da Robotica.news dell’11 settembre 2016

Fino a oggi lo abbiamo visto impiegato, grazie alle sue caratteristiche di androide “social” e specializzato nel tenere compagnia, come addetto all’accoglienza di negozi, hotel e perfino a bordo di navi.

Oggi Pepper, il robot creato dalla francese Aldebaran e sviluppato dalla giapponese SoftBank Robotics, lo ritroviamo in Italia, più precisamente nel reparto di pediatria dell‘Ospedale di Padova. Dove grazie all’interessamento della Fondazione privata Salus Pueri interagisce con i piccoli pazienti per supportarli psicologicamente, intervenendo soprattutto sulle loro paure.

Si tratta di una sperimentazione unica al momento in Italia, e se il test funzionerà Pepperpotrebbe essere assunto nella struttura, aprendo la strada a chiamate dei suoi modelli gemelli in altri centri di cura per bambini.

Alto 120 centimetri, pesante 30 kg, con un’autonomia di 12 ore, l’umanoide è in grado di capire la provenienza dei suoni e identificare le emozioni trasmesse dalla voce, decifrando poi dal volto del paziente il suo stato d’animo. E comportarsi di conseguenza: se un bambino ride, lui farà altrettanto, se piange cercherà di consolarlo, giocando e ballando.

Tutto questo tramite un sistema di 4 microfoni direzionali posizionati sulla testa del robot e di videocamere tridimensionali. Sul petto di Pepper spicca lo schermo del tablet tramite il quale si può scegliere tra le diverse modalità di interazione e impostare la connessione wi fiper controllarlo a distanza. Una rete di sensori permette infine al robot di muoversi senza sbandamenti o pericolo tra le corsie ospedaliere.

La ‘robot therapy’ sta affermandosi in molti paese come una efficace sostituta della pet therapy negli ospedali, specie per i più piccoli. Le ragioni sono soprattutto di natura igienica: è impossibile infatti utilizzare le bolle di sapone o un cucciolo d’animale per tranquillizzare una bambino che stia entrando in un ambiente sterile come una sala operatoria.

3. Robot, ciao Buddy ci vediamo a cena

Il corriere della sera 11 luglio 2016

Raccontano le favole, dettano ricette, danzano, leggono le espressioni del viso. Gli umanoidi stanno davvero arrivando nelle case. I costi? Si parte da 540 euro

Troveranno posto nelle case come i tablet o gli schermi piatti tv? È presto per dirlo, l’invasione sta appena per cominciare, grazie a modelli per il largo consumo in arrivo al prezzo di un elettrodomestico o di uno smartphone di alta gamma. Si tratta di oggetti hi-tech, però, molto più sofisticati e soprattutto autonomi: i personal robot destinati a farci compagnia, assisterci e divertirci.

Il primo test che dovranno superare sarà quello di essere bene accettati. Perciò sono progettati, anche nelle forme e nel design, per ispirare simpatia. Assomigliano a vedette del cinema come E.T. o il più recente Wall-E, il robottino protagonista del film di animazione della Pixar.

Fisionomia e prezzi

«Buddy» ha la testa tonda, gli occhioni e la mimica facciale infantile che serve a rassicurare o persino a favorire una relazione «emotiva». Parla, riconosce le persone e gli oggetti, controlla anche gli altri apparecchi della casa, regolando le luci o mettendo la musica. Può raccontare storie ai bambini o dettare una ricetta alla mamma in cucina.

Grandi occhi, faccia da smiley e un corpo ovale anche per «Zenbo», che gira per la casa su quattro rotelline, evitando gli ostacoli. Scatta le foto alla famiglia, ricorda gli impegni della giornata, si connette al web per rispondere a richieste e comunica con le app.

Zenbo è il nuovo nato in casa Asus, presentato a inizio giugno a Computex, la fiera dell’elettronica di Taipei, arriverà sul mercato entro fine anno a un prezzo a portata di famiglia: 599 dollari (540 euro circa). Buddy, che costa appena cento dollari di più, è nato invece da un progetto di Blue Frog Robotics, startup francese, lanciato sulla piattaforma di crowdfunding Indiegogo. Gli ordini sono aperti da giugno, ne sono già arrivati un migliaio, e le consegne cominceranno da ottobre.

Grazie al finanziamento collettivo è in arrivo dopo l’estate anche «Alpha2», lanciato da Ubtech, che ha raccolto 1 milione e 385 mila dollari. È la seconda versione del robottino Alpha, già presente sul mercato europeo. Un piccolo umanoide alto 40 cm, molto agile: sa danzare e se cade si rialza, imita i movimenti di ginnastica o tira di calcio. Come gli altri robot da intrattenimento, dialoga e si connette agli apparecchi della casa per fare da assistente personale, programmato facilmente tramite app. Saranno poi le qualità dettate dall’intelligenza artificiale e le capacità di interazione ad assicurare il successo di un modello o dell’altro.

«Anche se sono tutti proposti come intelligenti, questi piccoli robot per il mercato consumer nascono piuttosto sulla scia dell’Internet delle cose: l’idea è di avere dei tool , degli strumenti predisposti a una serie di azioni, che traggono vantaggio dalla connessione alla Rete, alle app, ai sensori», dice Amedeo Cesta, ricercatore dell’Istituto di cognitive sciences and Technologies del Cnr e presidente dell’Associazione italiana per l’Intelligenza Artificiale. «Naturalmente — prosegue — questi robot integrano tecniche di intelligenza artificiale, utilizzando i progressi raggiunti nel linguaggio naturale, nella visione, nell’apprendimento automatico. Ma sono macchine ancora limitate nell’autonomia». Non sono in grado di andare oltre i compiti per i quali sono state programmate, insomma. Com’è limitato il loro livello di comprensione delle persone. «Possono leggere magari le espressioni facciali — dice Cesta —, ma la capacità di percepire lo stato d’animo è ancora lontana dall’essere ottenuta».

Gli algoritmi

I progressi arriveranno con l’integrazione del Deep Learning (già in uso su modelli di robot più costosi, destinati a luoghi pubblici), cioè gli algoritmi che, replicando il funzionamento dei nostri neuroni, permettono di imparare dall’esperienza. Ci stanno investendo tutti i big: Google, Apple, Amazon, Facebook, per rendere più smart i personal assistent. E il 1 luglio Kazuo Hirai, amministratore delegato di Sony Corporation, ha annunciato in un’intervista al Wall Street Journal che sta preparando il ritorno sul mercato della robotica domestica.

Sony era stata la prima a sviluppare robot per il mercato consumer con Aibo, a forma di cagnolino, lanciato già nel 1999. Ora vuole tornare a cavalcare l’onda, grazie anche all’esperienza nei prodotti consumer e alla leadership sul mercato dei videogame, ottenuta con la Playstation. La robotica domestica, pur essendo ancora un mercato emergente, raggiungerà i 12 miliardi di dollari nel 2018 secondo l’International Federation of Robotics. E oltre la metà del valore (7,6 miliardi) è rappresentato proprio dai piccoli robot di intrattenimento.

4. Andrea Daniele Signorelli : Ma gli androidi sognano diritti civili?

da www.rivistastudio.com dell’8 luglio 2016

Una proposta in discussione al Parlamento Ue può essere l’antipasto di un futuro in cui i robot pretenderanno di votare e riprodursi.

La proposta europea non mira tanto alla tutela dei robot, quanto a porre le basi per un futuro in cui le grandi aziende siano obbligate a dichiarare quanto risparmiano grazie all’utilizzo delle «electronic persons» e a sostenere il sistema fiscale e previdenziale, contribuendo a far fronte allo spettro della disoccupazione di massa causata da un esercito di robot pronti a rubarci il lavoro. Un punto direttamente volto a favorire i robot in quanto tali, però, c’è: quello che fa riferimento alla proprietà intellettuale di poesie, canzoni e opere d’arte che, effettivamente, le intelligenze artificiali hanno iniziato a creare.

In ogni caso, nonostante le ragioni che hanno portato alla proposta europea siano soprattutto “umane”, il riconoscimento di questo status alle macchine artificiali sarebbe comunque un passaggio storico, che porta inevitabilmente a una domanda: se i robot sono persone, dobbiamo preoccuparci di garantire loro i diritti civili?

Stando a quanto scrive Luciano Floridi, professore di Etica a Oxford, si tratta di una preoccupazione prematura, perché bisognerebbe almeno attendere che gli androidi sviluppino una forma di autocoscienza, la condizione senza la quale non è possibile parlare di “persona”: «In che modo un’intelligenza artificiale possa evolvere autonomamente partendo dalle abilità necessarie, per esempio, a parcheggiare un’automobile in uno spazio stretto è ancora poco chiaro. La verità è che salire in cima a un albero non è il primo passo per arrivare alla Luna, ma è la fine del viaggio».

Altri studiosi, come quelli che fanno riferimento alla cosiddetta singolarità tecnologica , non sono così scettici sulla possibilità che i robot progrediscano fino a prendere coscienza di se stessi. Il problema semmai è come capire se i robot si stanno evolvendo a un ritmo tale da rendere necessario preoccuparsi dei loro diritti civili (prima, magari, che decidano di ribellarsi riducendo l’umanità in schiavitù).

Generalmente si fa riferimento al test di Turing, un criterio per determinare se una macchina è in grado di mostrare un comportamento abbastanza intelligente da non rendere più possibile distinguerla da un essere umano. Nel mondo della fantascienza più mainstream, il test di Turing (o qualcosa di molto simile) è stato utilizzato in Blade Runner per distinguere gli esseri umani dai replicanti e in Ex Machina per valutare l’evoluzione dell’androide Ava. In quello reale, però, siamo ancora ben lontani da tutto ciò: nonostante in ben tre casi sia stato rivendicato il successo in questo test, nessun computer l’ha ancora passato senza ricorrere a escamotage di vario tipo.

Non solo: Luciano Floridi contesta anche l’assunto secondo cui dobbiamo considerare una macchina intelligente nel momento in cui non riusciamo a distinguerla da un essere umano: il test di Turing in questo senso fornirebbe solo una condizione necessaria, ma non sufficiente. Dal punto di vista cognitivo, insomma, essere in grado di simulare un comportamento intelligente è cosa ben diversa dall’essere intelligente.

La posizione di Floridi viene però contestata da un altro professore di Oxford, il matematico Marcus du Sautoy, che propone di affiancare al Turing una seconda prova: il test del “riconoscimento nello specchio”. «Questa prova ha lo scopo di capire se un bambino (o un robot) è in grado di riconoscere la sua immagine e ha quindi sviluppato il senso del sé. Nel momento in cui ci accorgeremo che queste tecnologie hanno raggiunto un certo livello di coscienza, dovremo fornire loro dei diritti umani».

Eppure farlo non sarebbe una passeggiata: tra i diritti umani ci sono anche il diritto alla vita e quello al benessere (che ci impedirebbero di “uccidere” un robot, cioè di spegnerlo), il diritto alla libertà dalla schiavitù (che farebbe venire meno la ragione stessa per cui li stiamo creando) e il diritto alla procreazione, cioè permettere a un robot di creare copie di se stesso, l’unico modo in cui sarebbe in grado di procreare.

Dai diritti umani (tra i quali è contemplata anche la libertà di espressione: siamo pronti a non limitare il campo degli interventi delle macchine artificiali?) al diritto di voto, il passo è breve. D’altra parte, come si potrebbe negare a dei robot dotati di coscienza e che svolgono un ruolo produttivo nella società la possibilità di esprimersi politicamente? Arrivati a questo punto, la nostra società farebbe cortocircuito: «Le macchine rivendicheranno il diritto di fare copie di se stesse», sostiene in un saggio il professore di Legge all’Università di Washington Ryan Calo. «I robot (e tutte le loro copie) vorranno anche avere una loro rappresentanza in Parlamento e, infine, chiederanno di accedere al suffragio. Ovviamente, conferire questi diritti a esseri capaci di replicarsi in copie infinite distruggerebbe il nostro sistema di governo. Di quale diritto li priveremmo, allora: di quello fondamentale alla procreazione o di quello democratico alla partecipazione?».

Come si potrebbe negare a dei robot dotati di coscienza e che svolgono un ruolo produttivo nella società la possibilità di esprimersi politicamente?

Probabilmente, dovremmo privarli del diritto alla procreazione. Magari scovando qualche cavillo legale, come immaginato dal fisico e filosofo David Deutsch, secondo il quale dovremmo considerare come «una sola persona» tutte le copie di un robot, almeno fino a quando non inizieranno a differenziarsi grazie a diverse esperienze o decisioni. La questione, per quanto ultra-futuribile, è decisiva: in linea teorica sarebbe sufficiente che un’intelligenza artificiale imparasse a replicarsi all’interno di numerose macchine per aumentare esponenzialmente il suo peso elettorale. E magari un giorno diventare Presidente-robot della Repubblica.

Nulla lo esclude, visto che la Costituzione Italiana prevede che possa essere eletto presidente della Repubblica «ogni cittadino che abbia compiuto quaranta anni di età e goda dei diritti civili e politici». Visto che siamo in periodo di riforme costituzionali, forse dovremmo approfittarne per inserire da qualche parte il termine «essere umano». Ma è davvero il caso di interrogarsi su scenari che non solo sono molto lontani da venire, ma anche ancora ipotetici? In verità, sì. Anzi, se si considera ad esempio il vuoto legislativo riguardante le “self-driving car”, siamo già in ritardo. Mancano solo pochi anni alla messa in commercio delle auto che si guidano da sole e ancora non c’è una risposta alla domanda più scontata: di chi è la responsabilità se una di queste auto causa un incidente? Del guidatore, della macchina o del programmatore? Di tutti e tre o di nessuno?

La questione, in questo caso, è molto attuale. Nel febbraio di quest’anno, come racconta lo Scientific American, «una self-driving car di Google ha causato per la prima volta un incidente. Dopo aver individuato un ostacolo, la macchina si è spostata nella corsia centrale per evitare l’impatto. Tre secondi dopo si è scontrata con la fiancata di un bus. Stando al rapporto dell’incidente, l’intelligenza artificiale ai comandi della vettura aveva visto il bus, ma supponeva che avrebbe rallentato per permettere alla macchina di spostarsi nella sua corsia».

Non è la prima volta che una di queste vetture viene coinvolta in un incidente, ma è la prima volta in cui è l’auto senza pilota a causarlo. Da qui, la domanda: di chi è la responsabilità? Secondo gli esperti, lo scenario legislativo più probabile è che la colpa non ricada sul proprietario dell’auto (se non è responsabile dell’accaduto), ma sull’azienda che ha costruito il software che “guida” la vettura. In questo caso, quindi, a pagare i danni causati al bus sarà Google. Si tratta di un precedente importante, perché potrebbe sollevarci da ogni responsabilità per i danni causati dai robot che, nel futuro, manderemo a svolgere le commissioni al posto nostro. E soprattutto perché sapremo a chi dare la colpa nel momento in cui le intelligenze artificiali si ribelleranno agli umani, trasformando il sogno di un futuro tecnologico nell’incubo distopico di Skynet e Terminator.

5. Robotica: successo a Roma per RomeCup 2016. una edizione al femminile

da www.researchitaly.it 21 marzo 2016

Secondo la International Federation of Robotics (IFR), entro il 2018 saranno circa 1,3 milioni i robot che entreranno nelle fabbriche di tutto il mondo. Ma a registrare la crescita più significativa è la robotica di servizio: entro il 2018 infatti saranno più di 35 milioni i robot che verranno acquistati per “uso personale”, in aiuto a categorie fragili come anziani e persone con disabilità.

Sono i dati che emergono dalla 10ª edizione di “RomeCup, l’eccellenza della Robotica a Roma“, svoltasi in questi giorni a Roma. Organizzata dalla Fondazione Mondo Digitale, RomeCup è un multi evento dedicato alla robotica che dal 2007 diffonde l’innovazione collegando scuole, università, centri di ricerca, aziende e istituzioni, in questo modo avvicinando le nuove generazioni allo studio delle materie scientifiche e stimolando lo sviluppo di competenze professionali per l’occupazione nel contesto strategico delle politiche di “smart specialization”.

Quest’anno l’iniziativa si è focalizzata sulla tecnologia “al femminile”, riservando ampio spazio alle donne geniali della robotica, come Barbara Mazzolai, coordinatrice del Centro di Micro–Bio robotica dell’Istituto Italiano di Tecnologia (IIT), Cecilia Laschi, professore associate di Bio Robotica alla Scuola Sant’Anna di Pisa e Barbara Caputo, professore associato al Dipartimento di Ingegneria informatica della Sapienza Università di Roma, che hanno aperto l’evento con un convegno. Tra gli altri temi importanti messi sotto i riflettori in questa tre giorni, dal 16 al 18 marzo, quelli della ricerca e della sicurezza nel campo della realtà virtuale e dei droni.

Ai convegni e ai laboratori sono state affiancate vere e proprie gare fra robot: robot calciatori che giocano in modo completamente autonomo (non telecomandati) effettuando palleggi, passaggi e tiri in porta con un pallone a infrarossi; robot soccorritori programmati per intervenire nelle più disparate situazioni d’emergenza, dai terremoti agli attacchi terroristici, in grado di camminare tra le macerie, salire le scale, individuare le vittime; robot esploratori capaci di muoversi autonomamente alla ricerca degli obiettivi sconosciuti, che riescono a evitare ostacoli, districarsi in labirinti, fino a individuare la posizione di luci, gas o suoni segnalandone la presenza; robot danzatori in grado di esibirsi in coreografie scenografiche dal balletto classico all’hip hop con precisione e fluidità di movimento.

Numeri di indiscusso rispetto quelli di RomeCup 2016: quest’anno hanno partecipato 156 team composti da studenti di 58 scuole di 17 regioni, per un totale di 753 giovani protagonisti di competizioni e dimostrazioni, 80 docenti impegnati in 20 laboratori didattici; 85 gli stand con oltre 200 prototipi di robot.

Nel corso dell’evento si sono svolte le fasi di selezione della prima edizione delle “Olimpiadi di Robotica Educativa” promosse dalla Direzione generale per gli ordinamenti scolastici e la valutazione del sistema nazionale di istruzione del Ministero dell’Istruzione, dell’Università e della Ricerca (MIUR) in collaborazione con la Fondazione Mondo Digitale (FMD). Le premiazioni della prima edizione delle Olimpiadi – rivolte agli studenti della scuola secondaria di secondo grado per promuovere, incoraggiare e sostenerne le potenzialità didattiche e formative della robotica – si terrà a Parma il 24 maggio 2016 nell’ambito di Maifest, serata inaugurale della Fiera SPS IPC Drives Italia dedicata alle tecnologie per l’automazione elettrica e industriale, con la partecipazione di una rappresentanza delle scuole vincitrici.

Category: Ricerca e Innovazione